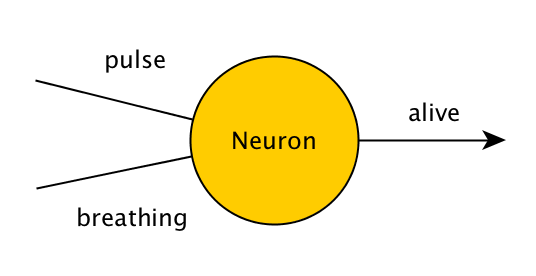

Neuroninis tinklas (dar vadinamas ANN arba dirbtiniu neuroniniu tinklu) – tai kompiuterinė struktūra ir programinė įranga, sukurta įkvėpta biologinių neuronų veikimo. Biologinės smegenys geba spręsti sudėtingas problemas, nes daug paprastų elementų (neuronų) veikia kartu: kiekvienas neuronas apdoroja tik nedidelę informacijos dalį, o bendras tinklas pateikia sprendimą. Panašiai ir dirbtiniai neuroniniai tinklai susideda iš daugybės paprastų skaičiavimo vienetų (neurono tipo mazgų), kurie kartu atlieka sudėtingus uždavinius. Tai vienas iš dirbtinio intelekto kūrimo metodų.

Pagrindinės sudedamosios dalys

- Neurono (mazgo) vienetas: gauna įėjimus, kiekvienam priskirtas svoris ir paprastai turi papildomą poslinkį (bias). Neuronas apskaičiuoja svoriuotą sumą ir per aktivacijos funkciją pateikia išėjimą.

- Sluoksniai: tinklas paprastai organizuotas į įėjimo, vieną ar kelis paslėptus ir išėjimo sluoksnius.

- Svoriai ir poslinkiai: reikšmės, kurias tinklas „mokosi“ siekdamas sumažinti klaidą.

- Aktyvacijos funkcijos: (pvz., sigmoidinė, tanh, ReLU, softmax) suteikia netiesiškumą ir leidžia tinklui modeliuoti sudėtingas priklausomybes.

Veikimo principas

Tinklas veikia dviem etapais:

- Forward pass (praleidimas į priekį): įėjimo duomenys perduodami per sluoksnius, kiekviename sluoksnyje apskaičiuojami mazgų išėjimai pagal svorius, poslinkius ir aktyvacijos funkcijas, kol gaunamas prognozė ar išėjimas.

- Backward pass (atgalinis praleidimas, backpropagation): lyginant tinklo išėjimą su tikruoju atsaku, apskaičiuojama klaida (loss). Ši klaida platinama atgal per tinklą, apskaičiuojant gradientus svoriams, kurie vėliau atnaujinami optimizatoriaus (pvz., gradientinio nuolydžio) pagalba.

Mokymas ir hiperparametrai

Neuroniniai tinklai dažniausiai mokomi naudojant daug pavyzdžių. Tai yra mašininio mokymosi forma — tinklas "mokosi" aptikti raštus iš duomenų ir gerinti savo sprendimus.

- Supervizuotas mokymas: naudojami etiketėti (pažymėti) duomenys; tinklas mokomas minimizuoti skirtumą tarp prognozių ir tikrųjų etikečių.

- Netiesioginis mokymas: klasterizacija, autoencoderiai arba savarankiškas (self-supervised) mokymas, kai etikečių nėra arba jos kuriamos iš duomenų pačių.

- Hiperparametrai: mokymosi greitis (learning rate), epochų skaičius, batch dydis, sluoksnių skaičius ir mazgų kiekis, reguliavimo metodai (pvz., dropout, L2) — visi jie daro įtaką tinklo veikimui.

Gilus mokymasis ir reikalingi ištekliai

Dideli, daugiasluoksniai tinklai – tai gilaus mokymosi požiūrio dalis. Kuo tinklas gilesnis ir sudėtingesnis, tuo daugiau duomenų ir skaičiavimo resursų jam reikia, kad būtų pasiektas geras generalizavimas. Dažnai tai reiškia didelius etikečių rinkinius (milijonai pavyzdžių) ir spartinančią aparatūrą (GPU, TPU).

Populiarios architektūros ir variantai

- Feedforward neuroniniai tinklai: informacija juda vienokia kryptimi nuo įėjimo link išėjimo — paprastas universalus modelis klasifikacijai ir regresijai.

- Konvoliuciniai neuroniniai tinklai (CNN): dažnai naudojami vaizdų ir signalų apdorojimui, gerai apdoroja vietines erdvines savybes.

- Rekurentiniai tinklai (RNN) ir jų variantai (LSTM, GRU): skirti sekų (tekstų, laikinių signalų) modeliui, geba įsiminti ankstesnę informaciją.

- Transformeriai: dabartinė lyderiaujanti architektūra natūralios kalbos apdorojime (NLP) ir kituose uždaviniuose; pagrįsti dėmesio (attention) mechanizmu.

Taikymai

Neuroniniai tinklai taikomi daugelyje sričių:

- Vaizdų klasifikacija, objektų aptikimas, medicininė vaizdinė diagnostika.

- Kalbos atpažinimas, teksto generavimas, vertimas ir kiti NLP uždaviniai.

- Rekomendacijų sistemos, finansų prognozavimas, anomalių atvejų aptikimas.

- Autonominė važiuoklė, robotika ir daugelis kitų sričių.

Iššūkiai ir apribojimai

- Duomenų poreikis: giliems tinklams reikalingi dideli ir įvairūs duomenų rinkiniai.

- Perpritaikymas (overfitting): tinklas gali pernelyg gerai „prisitaikyti“ prie mokymo duomenų ir blogai veikti su naujais duomenimis; naudojami reguliavimo būdai (dropout, L2, early stopping).

- Interpretacijos trūkumas: sudėtingi modeliai gali būti „juodosios dėžės“, todėl sunku paaiškinti sprendimų priežastis.

- Skaičiavimo kaštai ir energija: treniruotė gali būti brangi ir energijai reikli.

Vertinimas

Tinklo rezultatai vertinami pagal tinkamus rodiklius: tikslumas (accuracy), tikslumas/atsiminimas (precision/recall), F1 rodiklis, RMSE ar kiti priklausomai nuo uždavinio. Svarbu naudoti atskirą testų rinkinį, kad įvertintume tinklo gebėjimą generalizuoti.

Apibendrinant, neuroniniai tinklai yra galingas įrankis, leidžiantis automatizuoti ir pagerinti sprendimus daugelyje sričių. Jie imituoja idėją, kad daugybė paprastų elementų, veikdami kartu, gali spręsti sudėtingas problemas — tačiau praktikoje tai reikalauja tinkamo dizaino, daug duomenų, mokymosi ir atsargumo dėl etikos, interpretacijos ir išteklių ribų. Neuroniniai tinklai yra svarbi mašininio mokymosi dalis ir vienas iš pagrindinių gilaus mokymosi priemonių.